Quando l’IA cancella la realtà: il caso di Fatima Hassouneh (testo con aggiornamenti)

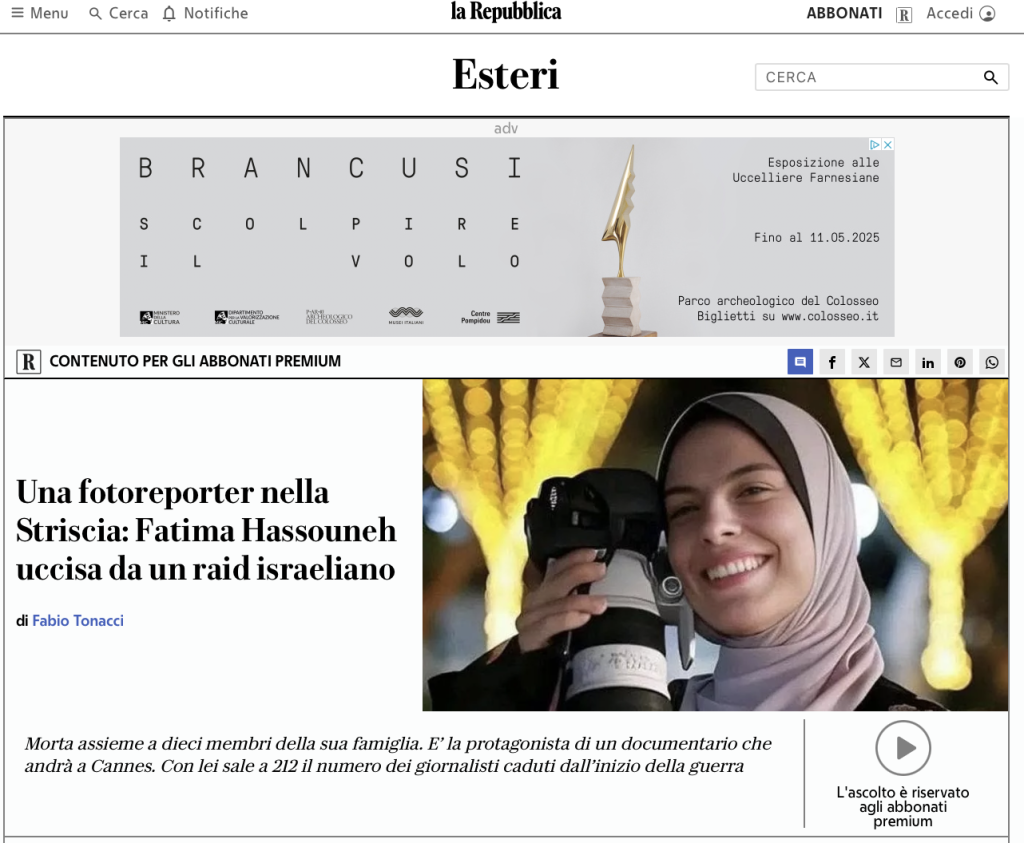

In queste settimane, l’immagine di una giovane fotografa con il sorriso luminoso e la fotocamera in mano è apparsa su giornali, blog e post social come tributo a Fatima Hassouneh, la giornalista palestinese uccisa a Gaza dall’esercito israeliano. Una donna forte, impegnata nel raccontare il suo popolo con la macchina fotografica come arma. Ma c’è un dettaglio sconcertante: quell’immagine sembra non essere reale (vedi ps in calce al testo).

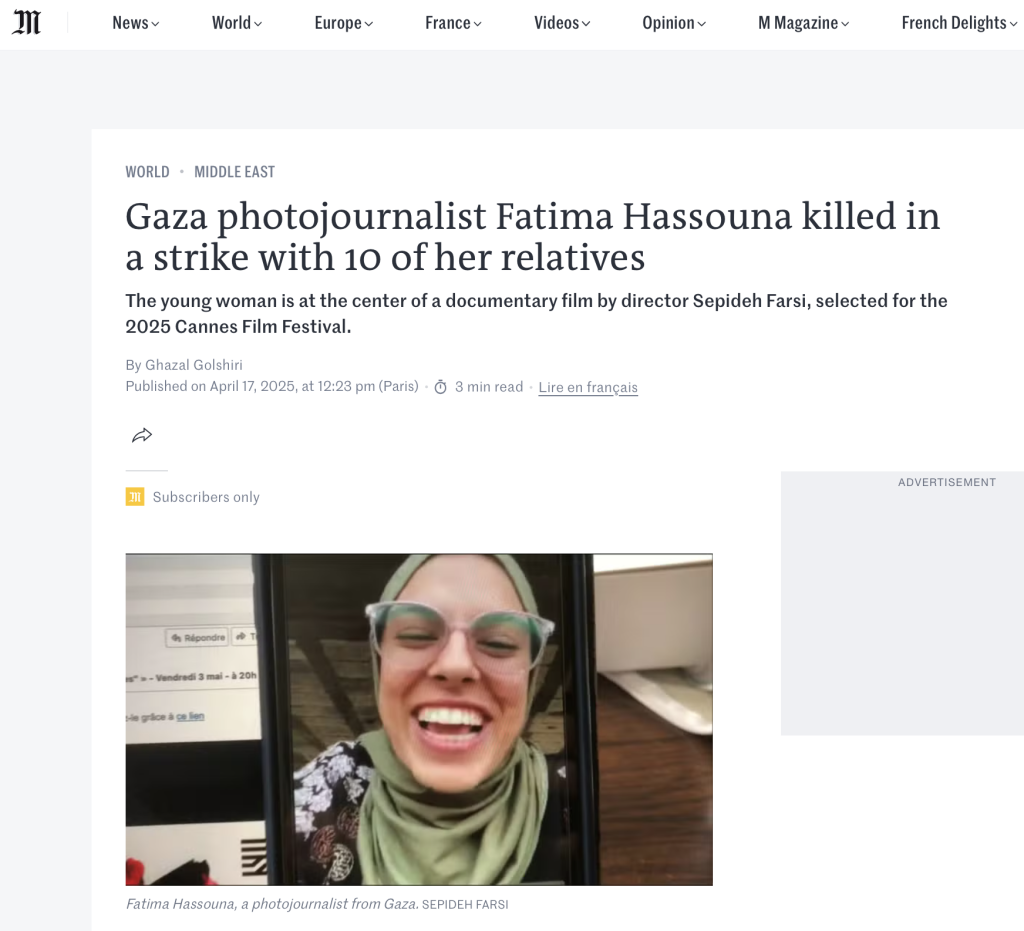

La foto che ha fatto il giro del mondo è stata generata da un’intelligenza artificiale. Nessuna fonte, nessun autore. Nessun volto vero. È un’illusione estetica, una figura femminile idealizzata, universalizzata, forse addolcita. Nel frattempo, la vera fotografia di Fatima, scattata sul campo, dove appare determinata, concentrata, con la fotocamera appoggiata sulla spalla, è stata ignorata dai più. Scartata. Invisibilizzata. Da una mia ricerca solo Il Manifesto – tra i giornali italiani – non ha utilizzato la sintografia, ma una fotografia della giornalista (magari anche altre testate lo hanno fatto e me ne scuso se non le ho trovate). Mentre all’estero testate importanti come il Time, la CNN, Euronews e Le Monde sono stati più attenti nella scelta dell’immagine riportando una foto ‘vera’ con i relativi crediti (The Guardian a parte con un doppio fake anche nei crediti).

Perché? Le risposte non sono semplici, ma alcune ipotesi vanno sollevate:

1. Estetica e neutralizzazione

La foto generata dall’IA aderisce a canoni estetici rassicuranti: luce morbida, sorriso accattivante, sfondo sfocato. È la versione “instagrammabile” del martirio. Una rappresentazione che permette ai media di toccare una tragedia da lontano, senza sporcarsi le mani con la verità (un po’ come la foto vincitrice del WPP 2025 della fotografa Samar Abu Elouf – sulla sinistra della copertina – sulla quale ho già scritto un articolo).

2. Controllo narrativo

Usare una rappresentazione fittizia significa controllare il racconto. Un volto generico è più facile da adattare a qualsiasi narrazione. Un volto vero, invece, impone una presa di posizione. Guardare negli occhi una donna palestinese che ha scelto di raccontare la guerra con la fotografia è un atto politico. Troppo scomodo per molte redazioni?

3. Questione di diritti

Un ulteriore fattore da non sottovalutare è quello economico e legale: utilizzare la vera immagine di Fatima potrebbe comportare il pagamento dei diritti al fotografo che l’ha scattata. L’immagine IA, invece, è gratuita, immediatamente accessibile, e priva di vincoli. Un vantaggio pratico che, purtroppo, contribuisce alla de-umanizzazione.

Un trend che rischia di diventare la norma

Questa pratica non è un episodio isolato: sta emergendo un trend preoccupante, in cui le immagini generate dall’IA vengono pubblicate accanto (o al posto) di fotografie vere, senza dichiararlo apertamente. E qui nasce una domanda cruciale: Sarebbe stato così difficile scrivere sotto l’immagine che si trattava di una sintografia, prodotta da un algoritmo? La risposta è no. Ma ammetterlo significherebbe fare i conti con un’altra realtà: l’etica professionale è stata aggirata.

Il giornalismo, per definizione, si fonda sulla fiducia, sulla trasparenza e sul rispetto dei fatti. Quando un’immagine generata artificialmente viene presentata come reale, senza contesto, senza spiegazioni, si rompe il patto con il lettore. E allora: se oggi normalizziamo la presenza di volti fittizi nel racconto della cronaca, cosa accadrà domani? Quando il dolore, la lotta, la memoria saranno “più comodi” da raccontare attraverso figure create al computer, cosa resterà dell’esperienza umana?

La verità ha un volto. E va mostrato.

Usare un’immagine falsa per ricordare una persona vera è una forma di cancellazione. Fatima Hassouneh esisteva. Aveva un nome, un volto, una voce. E aveva una missione: documentare, raccontare, testimoniare. Se davvero vogliamo onorare la sua memoria, dobbiamo mostrarla per ciò che era. Con la sua macchina fotografica. Con il suo sguardo. Con la sua storia. Perché dietro ogni volto reale c’è una verità. E la verità, semplicemente, non si può generare con un algoritmo.

P.S.: è doveroso aggiornare questo testo in data 24 Aprile 2025 a fronte di nuove informazioni a cura di Lorenzo Razzino. Questo è quanto scrive:

L’AI è una cosa molto complessa, da fotografo e appassionato di matematica la studio da un po’ di anni (ben prima che fosse così importante e presente per tutti). Con Claudio Palmisano oggi pomeriggio siamo andati a cercare l’origine di questa immagine e a tentare di capirne qualcosa in più. Alla base di tutto c’è una fotografia vera, caricata sul sito di Yura (https://www.yuraart.org/photographers/Fatma-Hassouna) e presente almeno dal 18 gennaio 2025 (secondo l’Internet Wayback Machine, ma questo significa solo che loro l’hanno individuata a partire da quella data, poteva essere stata caricata anche molto tempo prima). Questa è una foto, o almeno sembra esserlo senza troppi dubbi. Il volto, le mani, le scritte, il logo di Canon, è tutto corretto. Nulla di strano, è solo una fotografia in bassa risoluzione. Ma quello che vediamo invece in giro è ben più grande, dove con buona probabilità è stato utilizzato un software di ingrandimento AI come Topaz Gigapixel, o forse anche il sistema neurale introdotto nelle versioni più recenti di Photoshop. Questi sistemi provano a ricostruire l’immagine, e spesso intervengono (sbagliando) e modificando anche parti importanti. Il volto infatti, non è proprio uguale, se vogliamo dirla tutta. Quindi, a nostro avviso, non è esattamente una foto generata da zero, magari partendo da un prompt di testo. A scanso di equivoci, parliamo di una immagine sbagliata per questo utilizzo, ma siamo anche abbastanza sicuri che chiunque sia stato ad ingrandirla non si è nemmeno accorto che il volto di questa ragazza è nel frattempo cambiato. C’è bisogno di fare molta educazione sull’AI, di questo però siamo certi. Perché in questo caso è sì intelligenza artificiale, ma non nella misura in cui abbiamo pensato sin dall’inizio. Chi lo ha fatto probabilmente voleva solo una immagine più grande di quella che si trovava sul sito del collettivo.